آشنایی با بودجه خزش یا کرال باجت؟ + ترفندهای 2024 برای بهینه سازی آن

- 1 کرال باجت چیست؟

- 3 فاکتورهای اصلی تعیین کننده بودجه خزش کدامند؟

- 6 چرا کراول باجت سایت مهم است؟

- 7 نرخ کرال و نحوه تعیین آن

- 8 فرکانس خزیدن یا Crawl Frequency چیست؟

- 10 فاکتورهای موثر در تعیین فرکانس خزش

- 11 راهکارهای بهبود کرال بادجت؟

- 15 عوامل منفی در بودجه خزش

- 18 ابزارهای کنترل بودجه خزش

- 20 روشهای تشخیص کراول سایت توسط گوگل

- 22 نکات مکمل در مورد مفهوم کرال باجت؟

- 23 جمع بندی

- 24 سوالات متداول

- 29 من می خواهم گوگل سریع تر وبسایتم را کروال کند

- 33 چه کارهایی بودجه خزش را بهتر نمی کند؟

- 38 گوگل چگونه سایت ها را خزش می کند؟

- 41 من میخوام گوگل سایتم رو دیر به دیر کروال کنه!!!

در حال ثبت رای

در حال ثبت رای

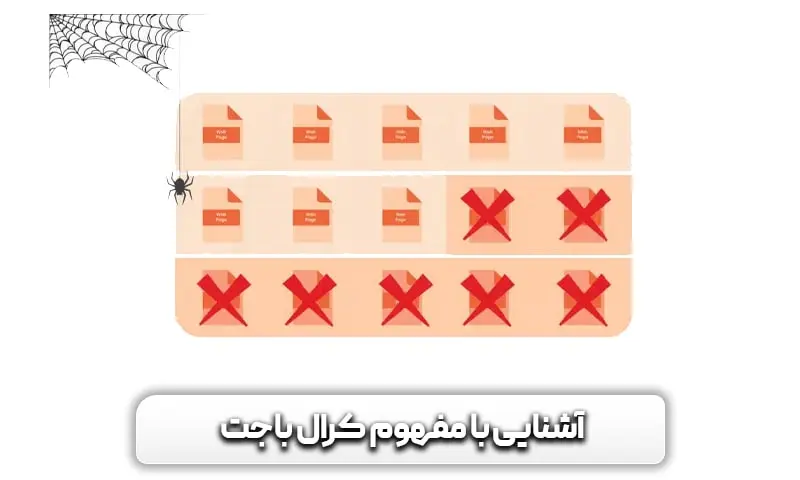

کرال باجت؟ بودجه خزش یا بودجه کراول اصطلاحاتی پرکاربرد و مهم به ویژه برای سایتهای بزرگ هستند که معمولا تعداد صفحات بیش از 5-10 هزار مورد را داشته و تولید محتوای بالایی دارند. امروزه با افزایش حجم تولید محتوا به بیش از 328 میلیون ترابایت در روز، خزش و ایندکس همه آنها کاری بسیار دشوار برای رباتهای گوگل و سایر سرچ انجینها است. در نتیجه محدودیتی برای ارزیابی هرپلتفرم توسط موتورهای جستجو درنظر گرفته شده است که متناسب با ویژگیهای هر سایت تعیین میشود. تعریف چنین پارامتری باعث شده تا عدم توجه به آن، مشکلاتی نظیر عدم ایندکس سریع مطالب و افزایش صفحات کراول نشده در برخی سایتها ایجاد گردد.

اگر قصد دارید به صورت کامل با این موضوع آشنا شده، فاکتورهای اثرگذار بر ظرفیت آن را بشناسید و ترفندهایی را برای بهبود آن انجام دهید، تا انتهای این مطلب همراه ما باشید. منبع اکثر مطالب بیان شده در مقاله پیش رو منطبق بر دادههایی است که از سوی گوگل ارائه شدهاند.

کرال باجت چیست؟

در یک تعریف کوتاه برای پاسخ به اینکه کرال باجت؟ یا بودجه خزش چیست؟ میتوان به تعریف گوگل اشاره کرد که میگوید:

“کرال بادجت اندازهای خاص از منابع و مدت زمان است که گوگل (Google Bots) برای کراول (خزیدن) سایت اختصاص میدهد.”

گوگل و موتورهای جستجو در تعریف چنین مفهومی، دلیل خود را بینهایت بودن فضای مجازی بیان کردهاند. در نتیجه کاوش و ایندکس کردن تمام صفحات سایتها را خارج از توانایی آنها میکند. به همین خاطر، محدودیتهایی از نظر زمانی و منبع برای گوگل باتها تعریف میشوند تا خزیدن صفحات مختلف هرسایت بنابر آن انجام شود.

بنابراین در یک توضیح سادهتر در مورد کرال بادجت؟ باید بدانید ظرفیتی محدود و خاص هر سایت است که برای ایندکس و کراول آن استفاده میشود.

دلیل تعریف محدودیت کرال بادجت توسط موتورهای جستجو چیست؟

برای آنکه بخواهیم محدودیت کرال باجت؟ که از سوی موتورهای جستجو اعمال شده را بهتر درک کنیم، میبایست مثالی را در این قسمت بیان کرد.

اگر صفحهای از سایتی را با مرورگر خود باز کنید، دهها درخواست از طرف Browser شما به سرور سایت ارسال میشوند. پس از چند لحظه شاهد لود سایت و اجزای آن خواهیم بود. انجام این پروسه نیازمند صرف یک مدت زمان و دستگاه (منابعی) است تا بتواند زمینه را برای مشاهده وب سایت مقابل فراهم کند.

در مقیاس کوچکتر، شما به عنوان یک فرد روزانه با تعداد کمی سایت سروکار داشته و از کامپیوتر یا دستگاه خود برای مشاهده آنها استفاده میکنید. اگر در این مثال یک موتور جستجو به جای شما و رباتهای خزنده به جای مرورگرتان قرار گیرند، میبایست میلیونها صفحه را به صورت روزانه در اینترنت جستجو کرده تا مطالب جدید آنها را ایندکس کنند. به همین خاطر لازم است برای هر سایت ظرفیت محدودی درنظر گرفته شود تا روزانه مطالب جدید از سایتهای مختلف ایندکس شوند.

از سوی دیگر گوگل بیان میکند که در پروسه کرال باجت؟، ربات خزنده یک شهروند خوب برای سایت است. به همین خاطر نوع رفتار این باتها به گونهای تعریف شده که در جریان کراول قصد دارند هرچه سریعتر خزیدن را بدون وارد کردن فشار زیاد به سرور سایت انجام دهند. در نتیجه گوگل باتها یک ظرفیت محدودی را بسته به هرسایتی درنظر میگیرند که این موضوع در تعیین مقدار کرال باجت؟ مهم است. این مفهوم با اصطلاحی به نام Crawl Rate بیان میشود که در ادامه بیشتر راجع به آن صحبت میکنیم.

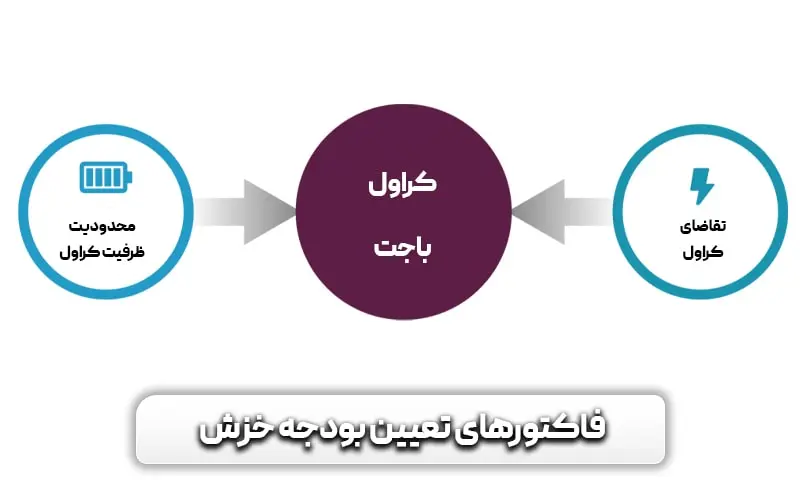

فاکتورهای اصلی تعیین کننده بودجه خزش کدامند؟

با درک مقدماتی مفهوم کرال باجت؟، ممکن است این پرسش برای شما مطرح شود که چه فاکتورهایی در تعیین محدودیت این مولفه برای هرسایتی اثر گذار هستند. قبل از بررسی 2 عامل اصلی، لازم است بدانید که اگر سایتی دارید که کمتر از چند هزار صفحه URLدار دارد در صورت عدم وجود مشکل تکنیکال در بیشتر موارد به طور موثر خزش آنها انجام میشوند.

بنابر آنچه گری ایلیز، تحلیلگر تیم موتور جستجوی گوگل بیان میکند، پارامترهای مهم برای تعیین محدودیت خزش سایتهای بزرگ عبارتند از:

- اولویت دادن به خزیدن.

- زمان و

- مقدار منابعی که سرور میزبان سایت میتواند برای کرال اختصاص دهد.

ظرفیت خزیدن

همانطور که در بخش قبل اشاره کردیم، رباتهای گوگل میخواهند سریعترین خزش اطلاعات را به گونهای که فشار زیادی به سرورها وارد نشود، انجام دهند. به همین خاطر یک محدودیت ظرفیت توسط آنها “محاسبه” میشود که برابر با حداکثر تعداد اتصالات موازی به صورت همزمان خواهد بود؛ به طوریکه رباتهای گوگل خزش سایت را به این صورت انجام دهند.

در تعیین محدودیت ظرفیت کرال باجت؟ که توسط رباتهای گوگل تعیین میشوند، میتوان 3 عامل را مهم دانست که به شرح زیر هستند:

تضمین انجام کامل پروسه خزش

در صورتیکه پروسه خزش به درستی و کامل انجام گردد، محدودیت اعمال شده کمتر میشود. به طور مثال در صورتی که سرور به سرعت پاسخ دهد، زمانی که رباتهای موتور جستجو اتصالات بیشتری را برقرار کنند، هنگامی که این باتها با خطاهای سرور مواجه نشوند یا زمانی که سرعت سایت شما افت نکند، کرال باجت؟ پتانسیل بالاتری خواهد داشت.

نکته: رفع مشکلات فنی، سرعت و سرور همگی در بخش سئو داخلی انجام میشوند. به همین خاطر توصیه میکنیم قبل از ایندکس سایت خود، نسبت به بهینه سازی کامل سئو داخلی اقدام نمایید.

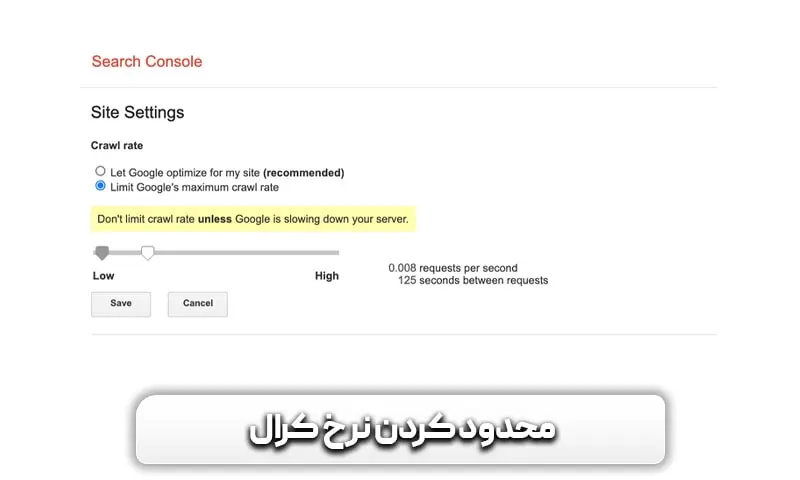

محدودیت تعیین شده در سرچ کنسول

عامل دیگری که میتوان در این قسمت به آن اشاره نمود، تعیین محدودهای است که به صورت اختیاری توسط صاحبین وب سایت جهت خزش سایت اعمال میشود. وبمستران میتوانند با مراجعه به این لینک، انتخاب دامین ثبت شده خود در سرچ کنسول که قبلا انجام شده باشد، نرخ کرال (Crawl Rate) سایت خود را تغییر دهند.

نکته: پس از انجام مرحله طراحی سایت، لازم است دامنه خود را در سرچ کنسول ثبت کنید. در صورتی که اقداماتی را برای تغییر نرخ کرال در این بخش انجام ندهید، تنظیمات پیش فرض در حالت توصیه شده و ماکزیمم خود برای تعیین محدودیت Crawl Budget قرار دارد؛ بنابراین این موضوع نگران کننده نخواهد بود.

محدودیت منابع موتورهای جستجو

همانطور که در ابتدای مطلب نیز برای آشنایی با کرال باجت؟ ذکر کردیم، گوگل رباتهای بسیار زیادی را برای خزش میلیونها صفحه در اختیار دارد. با این حال این حرف بدین معنا نیست که تعداد آنها نامحدود است. ممکن است به علت کمبود منابع موتور جستجو، ظرفیت خزش سایتها نیز تغییر کنند.

تقاضای خزیدن

مورد مهم دیگر در تعیین کرال باجت؟ تقاضای خزش سایت شما است. بدیهی است که چنین موضوعی برای سایتهای بزرگ و کوچک با یکدیگر تفاوت دارند. پلتفرمهایی که به طور مداوم تولید محتوا میکنند، نیاز به ظرفیت خزش بالاتری داشته و گوگل این موضوع را درک میکند. فاکتورهای تعیین کننده در این بخش علاوه بر نرخ بروزرسانی و کیفیت صفحه، شامل 3 مورد مهم زیر میباشد:

کلیات صفحات (موجودی) سایت شما

یکی از مواردی که در تعیین تقاضای خزیدن درنظر گرفته میشود، صفحات سایت شما است که میخواهید خزش شوند. در این صورت یک نکته کاربردی آن است که صفحاتی که نمیخواهید خزیده شوند را محدود کرده تا در استفاده مفید از زمان و بودجه خزش تغییر مثبتی ایجاد گردد.

محبوب بودن صفحات

یکی دیگر از مواردی که نزد گوگل تقاضای خزیدن یک سایت یا صفحه را مشخص میکند، محبوبیت صفحه است. به عنوان مثال اگر صفحه “آموزش سئو” سایت SEOEDU که یک مرجع برای درک کامل SEO است را درنظر بگیریم، گوگل آن را در اکثر مواقع کرال میکند تا از جدید بودن مطالب و آپدیت آن آگاه شود.

وقایع کلی

همچنین با جابهجا شدن سایت یا ایجاد تغییرات سراسری در سایت، افزایش تقاضای کرال باجت؟ به منظور ایندکس مجدد محتواها صورت میگیرد.

چرا کراول باجت سایت مهم است؟

دلیل اهمیت کرال باجت؟ چیست و چرا باید این مسئله مهم باشد؟ در پاسخ باید گفت این پارامتر هم برای گوگل و نیز وبمسترها مهم است. گوگل برای ایندکس صفحات با محتواهایی که میتوانند کاملتر و بهتر باشند، باید به طور مداوم این عمل را انجام دهد. با این حال با توجه به محدودیتی که دارد، لازم است تعیین ظرفیت کرال هر سایت و اولویت بندی این کار را به درستی انجام دهد.

از سوی دیگر وبمستران میبایست برای افزایش ایندکس صفحات مختلف سایت خود به این مسئله اهمیت دهند. در صورتیکه سایتی با تولید محتوای بالا دارند، بودجه کرال برای ایندکس و خزش تمام صفحات مهم است. در صورتی که مطالب با مخاطبان خاص خود را دارید، ایندکس روزانه صفحات سایت شما به منظور دسترسی سریعتر آنها به مطالب سایتتان مهم است.

یک مبحث دیگر از اهمیت کرال باجت، رتبه بندی سریعتر صفحات است. بدون کرال و ایندکس آنها نمیتوان انتظار رتبه بندی در نتایج موتور جستجو را داشت. پس بهتر است نرخ کرال سایت خود را بهبود دهید.

نرخ کرال و نحوه تعیین آن

مسئلهای که باید در کنار کرال باجت؟ به آن توجه کنید، نرخ کرال یا Crawl Rate است. نرخ کرال در یک تعریف خلاصه به شرح زیر میباشد:

“نرخ کرال را میتوان تعداد رکوئستهایی دانست که رباتهای خزنده گوگل در هر ثانیه برای کراول سایت شما ارسال میکنند.”

این فیچر به دلیل کاهش بار سرور توسط موتور جستجو معرفی شده است. به طور کلی امکان تعیین تعداد خزش سایت توسط گوگل وجود ندارد اما شما میتوانید با ثبت درخواست کرال URL مدنظر خود در سرچ کنسول، درخواست خزیدن مجدد کنید.

گوگل برای تعیین نرخ خزش الگوریتم خاص خود را دارد و به گونهای کار میکند که در هر بازدید، پهنای باند زیادی را از سایت شما مصرف نکند. همچنین گوگل محدود کردن کراول را برای وبمسترهایی که سرعت سرور آنها را کاهش میدهد، پیشنهاد کرده است که در بخش قبل راجع به آن روشی را بیان کردیم. نرخ خزیدنی که تعیین میشود، حداکثر عددی خواهد بود که گوگل باتها درنظر میگیرند. هرچند گوگل تضمین رسیدن به این حداکثر را توسط گوگل باتهای خود نداده است.

فرکانس خزیدن یا Crawl Frequency چیست؟

در نهایت اصطلاح مهم دیگری که باید در این مقاله به آن نیز توجه کنید، فرکانس خزش یا Crawl Frequency است. برای تعریف این مفهوم میتوان گفت:

“فرکانس خزیدن، تعداد مراتبی است که رباتهای گوگل برای خزش محتوای جدید یا به روز شده سایت شما وارد شده و این عمل را انجام میدهند.”

اهمیت فرکانس خزش

اهمیت این فاکتور در کنار کرال باجت؟ جایی خود را نشان خواهد داد که بخواهید برای مشاهده صفحات بروزرسانی شده یا جدید در نتایج گوگل اقدام کنید. اساسا ایندکس صفحات در یک سایت قبل از هرچیزی به پیش نیاز آن یعنی کرال شدن توسط باتهای موتور جستجو احتیاج دارد.

فاکتورهای موثر در تعیین فرکانس خزش

برای مشخص کردن فاکتورهایی که میتوانند در تعیین فرکانس خزش موثر باشند، برخی عوامل با کرال باجت؟ یکسان است. همچنین:

- تعداد دفعاتی که برای تولید محتوای جدید یا بروزرسانی صفحات سایت خود اقدام میکنید میتواند تعداد خزشها را افزایش دهد.

- محبوبیت و اعتبار دامنه یکی از فاکتورهای ترغیب کننده گوگل برای ایندکس مداوم و خزش پلتفرم شما است. اساسا موتورهای جستجو در میان میلیونها سایت و صفحات مرتبط به دنبال آنهایی هستند که محتوای باکیفیت، مرتبط و جذابی را ارائه میکنند.

نکته: یک عامل مهم در پشت پرده دامین آتوریتیها، بک لینکهایی است که از سایتهای دیگر به صفحات سایت شما پیوند داده شدهاند. این کار یک عامل برای ایجاد اقتدار و اعتبار در سئو خارجی برای دامنه شما است. گوگل با این ذهنیت و سنجش برخی پارامترها مانند هدایت ترافیک، تعداد بک لینکها و مرتبط بودن سایتهای بیرونی، به پلتفرم شما اعتماد کرده و رتبه بندی صفحات سایت را نیز بهبود میدهد.

راهکارهای بهبود کرال بادجت؟

به یکی از بخشهای مهم در این مقاله میرسیم که به روشهای بهبود کرال باجت؟ اختصاص مییابد. فرقی نمیکند چه نوع سایتی دارید، بهتر است همواره نکات زیر را برای بهبود نرخ کرال سایت خود درنظر بگیرید:

ارتقا سرور و هاست

همانطور که گفتیم، سالم بودن پروسه کرال یک شاخص بسیار مهم برای افزایش ظرفیت این پارامتر است سایتهایی که مشکلات فنی و توان سرور ضعیف دارند، خزیده نشده یا دیرتر کرال میشوند.

آپدیت و تولید محتوای فعال

آپدیت و تولید محتوای مداوم که در طول مطلب 2 بار به آن اشاره کردیم برای ترغیب گوگل به کرال مجدد سایت شما مهم است. شما میتوانید با مطالعه صفحه سئو محتوا اطلاعات بیشتری را راجع به این موضوع بدست آورید.

محدود کردن دسترسی باتهای خزنده

یکی دیگر از مواردی که میتواند در بهبود کرال باجت؟ سایت شما موثر باشد، محدود کردن دسترسی باتها به صفحات بیهوده است. از جمله میتوان به محتواهای کپی، صفحاتی با محتواهای ضعیف، URLهایی که قصد ندارید آنها را رتبه بندی کنید، صفحات با ارور 4XX، صفحات فاقد ارزش محتوایی یا تجاری مانند پنلهای کاربری و غیره اشاره کرد.

در حالت کلی توصیه ما این است که برای افزایش نرخ، فرکانس و ظرفیت کرال باجت سایت خود، پرکارتر، پویاتر و نیز محبوب و معتبرتر شوید.

عوامل منفی در بودجه خزش

در کنار موارد بالا که منجر به بهبود کرال باجت؟ میشوند، میتوان عوامل منفی در بودجه خزش را نیز معرفی کرد که به شرح زیر هستند:

ناوبری وجهی و سشن های شناسهها

ناوبریهای وجهی (Faceted Navigation) و سشن شناسهها (Session Identifiers) یک معضل مهم برای کرال باجت؟ هستند. آنها با ایجاد صفحات بیش از حد و خودکار که هرکدام URLهای خاص خود را دارند، در خزش سایت، ایندکس صفحات بیشتر و عدم دسترسی به دیگر پیجهای مهم اختلال ایجاد میکنند. همچنین پیمایشهای وجهی میتواند منجر به کاهش ارزش پیوند صفحه شود.

برای رفع این مشکل که در سایتهای فروشگاهی بسیار دیده شده و مهم است، باید از خدمات تکنیکال سئو استفاده کنید. مثلا روش اول آن است که تگ “nofollow” را به هر پیوند ناوبری اضافه کنید. روش دوم، اضافه کردن تگ ” noindex” به این صفحات است. روش سوم، استفاده از فایل Robots.txt است که جلوتر راجع به آن توضیح میدهیم. همچنین شما میتوانید از تگ کنونیکال نیز استفاده کنید.

کیفیت پایین محتوا

خزندهها با مشاهده محتواهای وب که کیفیت پایینی دارند و یا اسپم تلقی میشوند، بودجه خزش شما را کمتر خواهند کرد.

ابزارهای کنترل بودجه خزش

برخی از ابزارهایی که میتوانید به کمک آنها برای بهبود کرال باجت؟ سایت خود و رفع مشکلات ناشی از آن استفاده کنید عبارتند از:

فایل ربات سایت – Robots.txt

به طور کلی فایل Robots.txt نقش مهمی در تعیین بخشهایی از سایت که میخواهید آنها را کرال کنید دارد. شما میتوانید محدودیتهایی را با دستور disallow در این بخش تعیین نمایید. مثلا در برخورد با مشکل ناوبریهای وجهی، برای URLهای غیر ضروری میتوان از این فایل استفاده کرد. به عنوان نمونه شما میتوانید از کد زیر استفاده کنید:

User-agent: *

Disallow: *size=*

در صورتی که پیمایش وجهی شما اقدام به اضافه کردن دایرکتوری میکند، شکل کد بالا به حالت زیر در میآید:

User-agent: *

Disallow: */size/*

در صورتی که الگوی خاصی در ایجاد دایرکتوریها ندارید یا در سایتهای بزرگ قصد دارید یک دسته بندی را کاملا غیر قابل کراول کرده اما در عین حال ویژگی خاصی از آن را کرال کنید، چنین اهدافی ممکن است با این متد به درستی کار نکنند.

نکته: مسدود کردن برخی لینکها برای مدیریت کرال باجت؟ توسط فایل Robots.txt لزوما منجر به ایندکس نشدن آن نخواهد شد. در صورتی که هیچ پارامتری به با ارزش بودن آن URL اشاره نکند، میتوان انتظار داشت که نمایه سازی چنین صفحاتی انجام نشوند.

سایت مپ – Sitemap

سایت مپ از جهات مختلفی در کرال باجت؟ شما تاثیر گذار است که عبارتند از:

- سایت مپها در عمق خزش سایت شما توسط باتهای گوگل تاثیر میگذارند.

- اضافه کردن URL صفحات مهم به نقشه سایت کمک میکند تا موتور جستجو سیگنال مهم و اولویت دار بودن این صفحات را در هنگام خزیدن وب سایت درک کند.

- سایت مپ کمک میکند تا باتها استراکچر سایت شما را درک کنند.

شما میتوانید صفحاتی که ارزش محتوایی یا ایندکس شدن را ندارند، صفحاتی غیر از وضعیت 200 را از سایت مپ خود حذف کنید. این تکنیک یک روش برای کنترل و مدیریت خزش سایت شما توسط باتهای گوگل خواهد بود.

شما کاربران میتوانید با شرکت در منتورینگ سئو، به صورت عملی با روشهای تشخیص این مشکل و راهکارها یا ابزارهای رفع آن آشنا شوید.

بنابراین سایت مپ برای تعیین اولویت دار بودن صفحات مهم شما و ایجاد یک دید از وضعیت سایت به خصوص در سایتهای بزرگ کاربردی است.

روشهای تشخیص کراول سایت توسط گوگل

شاید برای شما جالب باشد که بفهمید چه زمانی سایت شما کرال شده است. در این رابطه میتوان به 2 راهکار زیر اشاره نمود که عبارتند از:

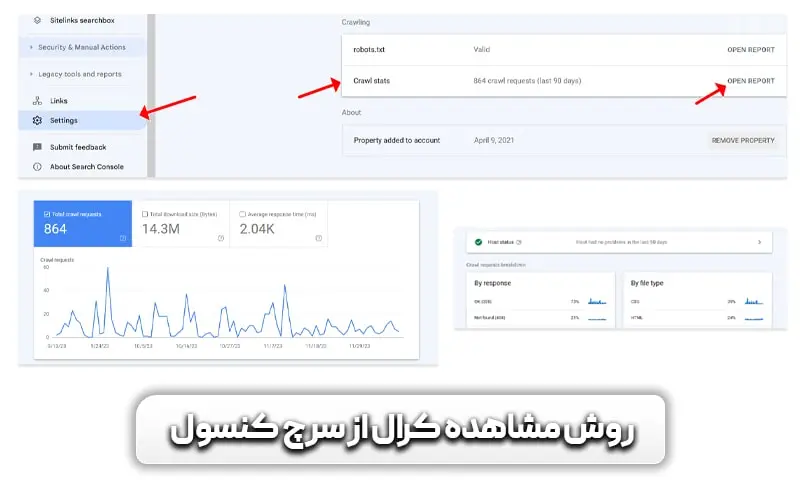

گزارش کرال استاتوس ریپورت سرچ کنسول

برای مشاهده کرالهای رباتهای گوگل در سایت شما مراحل زیر را طی کنید:

- با ثبت دامنه در سرچ کنسول، کافیست به این محیط کاربری بروید و دامنه خود را انتخاب کنید.

- حال و از منوی سمت چپ، روی گزینه “Setting” کلیک کنید.

- در مرحله بعدی روی گزینه “Crawl Stats” کلیک کنید.

- بر روی گزینه “Open Report” کلیک کنید.

حال گزارشی از میزان کرال باجت؟ سایت شما و تعداد درخواستها در هر بار ورود را مشاهده میکنید. همچنین گزارشات دیگر از میزان صفحات با کدهای HTTP (نظیر 200 (OK)، 404 (Not Found) و غیره را خواهید یافت).

گزارش کرال باجت سایت از طریق فایل لاگ (Log) هاست

یکی دیگر از بهترین مکانهایی که میتوانید کرال باجت؟ و ورود رباتهای گوگل به سایتتان را درک کنید، گزارش دریافتی در server log files است. در واقع زمانی که گوگل از سایت شما بازدید میکند، از یک عامل کاربری با نام مشخص “GoogleBot” استفاده مینماید.

- برای انجام این کار وارد هاست سایت خود شده و در پنل دایرکت ادمین یا غیره، به جستجوی گزینه خلاصه سایت / آمارها / لاگها باشید.

- روی این بخش کلیک کرده و داخل آن شوید.

- در بخش HTTP Logs، روی گزینه Access Logs و بر روی گزینه View کلیک کنید. در این حالت درخواستهای سایت را مشاهده میکنید.

- برای فیلتر کردن ربات گوگل، کافیست در قسمت جستجو عبارت “GoogleBot” را بنویسید.

نکات مکمل در مورد مفهوم کرال باجت؟

برای تکمیل این بحث و آشنایی شما با مفهوم کرال باجت؟، ویژگیها و اهمیت آن میتوان به چندین نکته مکمل نیز اشاره کرد که عبارتند از:

- به این نکته توجه کنید که در فرآیند خزش، هرچیزی که کراول شود ایندکس نمیگردد.

- گوگل این قول را داده است که اگر سایتی کمتر از چندهزار صفحه URL داشته باشد، در بیشتر مواقع به طور موثر خزیده میشود. این نکته نشان میدهد گوگل در خزش تعداد زیادی از سایتها در بازه زمانی کم توانایی بالایی دارد.

- با توجه به نکته بالا، کسانی که سایت کوچکی دارند، نیازی به نگرانی بیش از حد در مورد کرال سایت نخواهند و نباید داشته باشند.

- به این نکته توجه کنید که اگر کرال باجت؟ به انتها نرسیده باشد و یا تقاضای خزش کم باشد، گوگل باتها سایت شما را کمتر خزش میکنند.

- بنابر توصیه گوگل به جز در حالتی که مشکلات بارگذاری سرور ایجاد میشوند، بهتر است تغییراتی در نرخ خزش ایجاد نکنید.

جمع بندی

با توجه به مطالب بیان شده در این مقاله متوجه شدیم که گوگل با درنظر گرفتن 2 عامل اصلی یعنی محدودیت ظرفیت خزش و تقاضای خزیدن، کرال باجت؟ آنها را تعیین میکند. همچنین در یک تعریف نهایی دیگر باید گفت:

“کراول بادجت یک سایت یک دسته از URLهایی است که گوگل باتها میخواهند و میتوانند آن را خزش کنند.”

سوالات متداول

برخی از سوالاتی که ممکن است در هنگام خواندن این متن و راجع به کرال باجت؟ برای شما مطرح شوند عبارتند از:

کراول موازی چیست؟

به طور خلاصه منظور از اتصالات موازی (parallel connections) در کرال آن است که چندین فرآیند به صورت موازی اجرا شوند. این متد برای افزایش سرعت دانلود و کاهش هزینهها، جلوگیری از بارگیری مجدد صفحات سایت انجام میشود. کراولرها، برنامههایی هستند که صفحات وب را بارگیری، ذخیره و با ایجاد مجموعهای از URLها و اولویت بندی آنها، یک صف ایجاد میکنند. این پروسه کراول تا زمانی که خزنده تصمیم به توقف کار خود بگیرد، انجام میشود. با افزایش حجم وب، بازیابی کل یا بخش بزرگی از وب سایت در یک فرآیند دشوار شده و به همین خاطر چندین فرآیند به صورت موازی برای کراول انجام میشود.

فرآیند ایندکس سایت با توجه به مطالب فوق چگونه است؟

با توجه به مطالبی که بیان کردیم، تعیین کرال ریت، اولویت بندی کردن URLها و خزش سایت در ابتدا انجام شده و در نهایت برای نمایه سازی صفحات تصمیم گیری میشود.

آیا سایتهای کوچک به کرال باجت بیتوجه باشند؟

خیر؛ معمولا مشکل کرال باجت؟ سایت زمانی به معضل قابل توجه تبدیل میشود که سایت شما بیش از هزاران صفحه داشته باشد و کرال و ایندکس آن درست انجام نشود. با این وجود، سایتهای کوچک با داشتن مشکلات تکنیکال که غالبا نادیده گرفته میشوند نیز به عملکرد نامطلوب در این بخش دچار میشوند. حتی سایتهای کوچک نیز قادرند به دلیل وجود پیمایشهای وجهی (faceted navigation)، وجود فیلترها، باگهای موجود در سیستم مدیریت محتوا و غیره، هزار URL یونیک را ایجاد کنند. به همین خاطر مهم است که برای اطمینان از عدم ایجاد مشکل در کرال باجت از خدمات سئو در رفع آنها غافل نشوید.

سرعت کرال باجت به چه عواملی بستگی دارد؟

از جمله عوامل مهم در این موضوع میتوان به محبوبیت وب سایت، لینکسازی داخلی و استراکچر سایت، وضعیت سرور سایت، تغییرات محتوا و به روزرسانی آن اشاره کرد.

من می خواهم گوگل سریع تر وبسایتم را کروال کند

چند راه وجود دارد تا شما بتوانید میزان بودجه خزش وبسایت خود را افزایش دهید و با چک کردن آن ها قطعا به میزان کروال وبسایت شما کمک بسیار زیادی خواهد کرد.

سرعت سرور خود را افزایش دهید

یکی از موضوعاتی که باعث می شود تا میزان خزش شما افزایش پیدا کند، مسئله تقویت سرور و منابع شما می باشد. هرچه سرعت سایت شما بهینه تر و همینطور سرور قوی تری داشته باشید باعث می شود تا زمانی که ربات های گوگل فایل های داخل سایت یعنی صفحات سایت را دانلود می کند منابع کمتری را شامل شوند و در نتیجه میتواند بودجه خزش شما را افزایش دهد.

وجود لینک های داخلی و خارجی زیاد

استفاده از لینک های داخلی و خارجی زیاد می تواند میزان بودجه خزش را افزایش دهد و این موضوع به این صورت است که، وقتی ربات گوگل وارد یک صفحه می شود و با لینک های داخلی زیاد (البته نه اسپم) رو به رو میشود باید تمامی آن لینک ها را کروال کند.

تصور کنید ربات گوگل فضول ترین شخص در دنیای وب باشد، هر جا لینک ببینید آن را پیگیری می کند.

زمانی که در دفعه اول، لینک های زیادی را ببینید و نتواند همه را کراول کند قطعا مجبور است برای کروال بعدی خود، میزان نرخ بودجه خزش را افزایش داده تا در نتیجه بتواند تمامی صفحات را بررسی نماید.

از این روش شما می توانید برای بحث افزایش میزان بودجه خزش وبسایت خود استفاده کنید. اما نکته ای که وجود دارد این است که برای لینک های خارجی هم به همین صورت است اما خوب لینک های خارجی ما دسترسی کمتری به آن ها داریم و در نتیجه لینک داخلی گزینه بهتر و مناسب تری می باشد.

اما شما می توانید با شرکت در دوره آموزش لینک سازی خارجی، به راحتی بک لینک های خود را در کوتاه ترین زمان ممکن ساخته و همینطور به صورت کاملا طبیعی این روش را یاد بگیرید.

ریدایرکت ها و لینک های شکسته را درست کنید

در مورد موضوع ریدایرکت ها و لینک های شکسته، بهتر است توجه داشته باشید که شما با درست کردن آن ها می توانید ربات گوگل را بهتر در صفحات خود هدایت کنید.

تصور کنید وارد یک ساختمان می شوید و در آن ساختمان تعداد زیادی در وجود دارد، شما در اول را باز می کنید و متوجه می شوید که پشت آن هیچ چیزی وجود ندارد و در نتیجه برای باز کردن درهای دیگر اشتیاقی نخواهید داشت.

این اتفاق دقیقا برای ربات های گوگل نیز رخ خواهد داد. پس مراقب باشید صفحات با ارور های 4xx و 3xx را در وبسایت خود درست کنید.

یک ابزار عالی که می تواند درمورد موضوع لینک های شکسته و ریدایرکت ها به شما کمک کند ahrefs می باشد که شما می توانید از بخش reports وارد قسمت internal pages شده و از آن جا صفحات خود را بررسی کنید.

البته استفاده از ابزار اسکریمینگ فراگ نیز میتواند به شما در این موضوع کمک کند.

چه کارهایی بودجه خزش را بهتر نمی کند؟

1- تغییرات کوچک در صفحات سایت

گوگل خیلی باهوش تر از این حرفاست!

زمانی که شما فقط تاریخ انتشار، رنگ یک متن، علامت گذاری ها و امثال این ها را تغییر میدهید قطعا به این تغییرات توجهی نخواهد کرد و قرار نیست به خاطر آن ها به شما بودجه خزش بیشتری بدهد.

2- دست کاری در فایل robots.txt

بعضی ها فکر می کنند با تغییر دسترسی ها در فایل robots.txt می تواننداین موضوع را تغییر دهند در صورتی که این یک مسئله کاملا رد شده می باشد و گوگل به آن اهمیتی نمی دهد. پس شما که این مقاله را از seoedu مطالعه کرده اید هیچ وقت به دنبال انجام چنین کارهایی نخواهید بود.

3- عدم استفاده از تگ های nofollow

یکی از شایعاتی که در ذهن عزیزان وجود دارد این است که استفاده از تگ های نوفالو در صفحه منجر به کاهش نرخ خزش می شود. آخه این چه حرفیه ????

4-حذف کردن third-party scripts

باید بدانید که موضوع فایل های third-party scripts تاثیری در میزان نرخ بودجه شما نخواهد داشت. منظور از third-party scripts این است که شما کدهای جاوایی که از جای دیگر فراخوانی می شوند مثل کدهای وبسایت آپارت.

گوگل چگونه سایت ها را خزش می کند؟

هر وبسایت دارای میزان مشخصی از بودجه خزش می باشد که گوگل آن را برایش تعیین می کند. حال اینکه چطوری مشخص می شود باید گفت که بر اساس چندین ورودی این موضوع مشخص می گردد.

1- میزان درخواست خزش

اینکه سایت شما چه میزان درخواست برای خزش برای گوگل ارسال می کند، چه تعداد صفحه در روز تولید می کند و اینکه این صفحات چقدر اهمیت دارند، تعیین کننده این است که گوگل چه میزان بودجه را برای وبسایت شما در نظر بگیرد. زمانی که شما سفارش تولید محتوا متنی سایت خود را جدی نگرفته و صفحات خیلی بد و افتضاح به سایت اضافه کنید، قطعا گوگل به شما اهمیتی نخواهد داد.

قطعا صفحات سایت شما که میزان قابل توجهی لینک داخلی داشته باشند، ابتدا گوگل آن ها را ایندکس و بررسی می کند. شما می توانید این صفحات که میزان خیلی زیاد لینک داخلی دریافت کرده اند را از صفحه سرچ کنسول خود از قسمت links استخراج کنید.

اما این ها هیچ کدام دلیل بر آن نیست که میزان بودجه خزش را بفهمیم، گوگل صفحه ای را که روز اول خزیده است، روز دوم خزش می کند و اگر تغییری مشاهده نکند فرضا 2 روز بعد مجدد به آن سر میزند و همینطور در بازه های 10، 100 و … خزش کرده و زمانی که متوجه شود دیگر هیچ تغییری در آن رخ نداده دیگر هرگز کروال نخواهد کرد.

اما در کل زمانی که گوگل تغییرات زیاد و بزرگی را در صفحات سایت شما ببینید قطعا به صورت مداوم به سایت شما سر زده و به طور موقت میزان بودجه خزش را افزایش می دهد.

2- محدودیت نرخ خزش

زمانی که وبسایت شما گنجایش خزش زیاد را نداشته باشد، ربات ها به صورت اتومات سعی می کنند تا به وبسایت صدمه ای وارد نکنند و در نتیجه میزان نرخ خزش را کاهش می دهند که این موضوع می تواند به ساختار و طراحی سایت و همینطور هاستینگ شما مرتبط باشد.

تصور کنید میزان نرخ خزش زیادی بر روی سایت شما انجام گیرد، قطعا وبسایت شما دچار مشکل شده و منابع آن مصرف شده و از دسترس خارج خواهد شد. پس هر وبسایت با توجه به محدودیت ها و ظرفیت خود، بودجه را دریافت می کند.

من میخوام گوگل سایتم رو دیر به دیر کروال کنه!!!

چند راه وجود دارد که می توانید با استفاده از آن ها نرخ خزش را کاهش دهید که البته این ها را اصلا پیشنهاد نمی کنم و مسئولیت آن برعهده خودتان می باشد.

یکی از راه هایی که وجود دارد استفاده از ابزار خود گوگل برای کاهش میزان نرخ کروال می باشد. شما می توانید از طریق سرچ کنسول وبسایت خود از این لینک میزان نرخ بودجه خزش وبسایت خود را کم یا زیاد کنید.

اما اضافه کردن میزان نرخ خزش در این بخش می تواند ریسک پذیر باشد و به وبسایت شما ضربه بزند.

باز هم این مورد را تاکید می کنیم که تغییرات در تنظیمات این بخش مسئولیتی برعهده تیم seoedu نداشته و برعهده خودتان می باشد.

من محمد رضا دهقانی، مدیر آکادمی seoedu خوشحالم که در این مقاله نیز با شما همراه بودم. امیدوارم که توانسته باشم تجربه جدیدی را برای شما خلق کنم. در صورت داشتن هر گونه سوال و اشکال درمورد مطالب گفته شده می توانید از بخش دیدگاه ها اقدام نمایید و من سعی می کنم در کوتاه ترین زمان ممکن به سوال شما پاسخ دهم.

دیدگاهتان را بنویسید